当今时代,认知图像和视频处理对计算能力的需求呈爆炸式增长。虽然卷积神经网络提高了图像处理的性能,但它们的功耗和内存需求也显着增加。OpenAI 的一项调查显示,2012 年至 2018 年间,计算量增长超过 30 万倍。相比之下,在同一时期,摩尔定律仅使计算能力增加了七倍。为了满足对计算能力不断增长的需求,研究人员转向光子学作为增强卷积神经网络的手段。爱琴海大学、西阿提卡大学的一个研究小组,

他们的评论文章于 6 月 5 日发表在《智能计算》( Science Partner Journal)上。

为什么卷积神经网络需要光子计算?

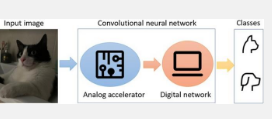

卷积神经网络是一类人工神经网络,它已经彻底改变了各个领域,特别是图像识别、目标检测和图像分割等计算机视觉任务。卷积神经网络受到人脑视觉处理机制的启发,旨在从输入数据中自动学习分层表示。

当卷积神经网络变得更深并且具有更多可训练参数时,它们的性能往往会提高。然而,这种改进是有代价的。功耗和内存需求也显着增加。在图像处理领域,卷积神经网络的卷积阶段消耗了总功耗的 80% 左右。为了满足不断增长的需求,公司和研究人员正在尝试使用多个芯片并利用并行处理。然而,这种方法会导致能源使用量显着增加,这在扩大系统规模时引发了财务成本和生态影响方面的担忧。

光子计算如何工作?

光子学利用光的独特特性来传输和处理信息,彻底改变数据通信等应用。集成光子卷积神经网络是一种使用特殊光学设备加速卷积神经网络计算的方法。诀窍是将卷积神经网络中的卷积步骤转换为一系列矩阵乘法。在这种方法中,图像被分割成小块,每个块都变成矩阵中的一行。卷积中使用的滤波器或内核表示为另一个矩阵中的列,每列包含内核的权重。卷积结果是通过这两个矩阵之间执行矩阵乘法获得的。

在集成光子学中,采用了类似的过程,但使用的是光。图像块被转换成光信号,核权重被存储在特殊的芯片中。光信号被发送到芯片中,在芯片内部经历利用光进行矩阵乘法的过程。该芯片是专门为这些计算而设计的,就像一个用于光的迷你计算机。这些芯片有不同类型,但它们都使用光来进行计算。这些芯片称为光子集成电路。一些光子集成电路是可重新编程的,这意味着它们可以改变以执行不同的计算。其他是固定的并为特定任务而设计。

光子计算如何加速卷积神经网络?

使用光加速图像处理的一种方法是光谱切片方法。想象一下,一台机器可以通过将图像分解为不同的颜色和图案来快速分析图像。该机器在分析图像之前不需要复杂的电路或图像预处理。该方法使用特殊的滤镜,根据颜色和图案将图像分成不同的部分。这些过滤器协同工作,从图像中提取重要特征。通过使用这种方法,机器变得可扩展,这意味着它可以处理更大、更复杂的图像。这种方法消耗的能量非常少,因为它只需要少量的能量来检测光和处理信号。它还可以立即工作,没有任何延迟,因此可以实时处理图像。

另一种光子加速器采用生物同构方法,使用微型尖峰激光神经元和无监督的仿生训练。这种深度架构提供了抗噪声且节能的解决方案。激光神经元模拟生物神经元的尖峰行为,提供对噪声的鲁棒性。无监督的仿生训练自动从数据中提取有意义的特征,无需显式标签即可进行模式识别。基于光子学的信息处理可提高能源效率。通过利用这些技术,加速器实现了噪声恢复能力并降低了功耗。总之,替代方法结合了小型化尖峰激光神经元、无监督仿生训练和光子学,以创建高效且抗噪声的深度学习解决方案。

标签:

免责声明:本文由用户上传,如有侵权请联系删除!